Hvordan skal du forholde dig til den nye AI-lovgivning?

Kunstig intelligens (AI) transformerer hurtigt industrier på et globalt plan – men med de nye muligheder kommer også et behov for juridiske krav og overvejelser. I denne oversigt, vil vi dykke ned i de juridiske forpligtelser defineret af den nye AI-lov og give vores bud på hvordan I proaktivt kan forberede jer på at imødekomme nogen af disse krav i jeres organisation.

Forfattere:

Hugo Lloyd, Legal Consultant hos Knowit Cybersecurity & Law

Natasha Christiansen, Strategy Consultant hos Knowit Experience

I øjeblikket behandler EU et forslag til en forordning, der vil fastsætte juridiske regler om kunstig intelligens, den såkaldte AI-lov. Selvom forordningen er under forhandling, har Det Europæiske Råd og Europa Parlamentet godkendt et første udkast. Forslaget har til formål at tackle de risici som AI udgør, indenfor sundhed, sikkerhed og grundlæggende rettigheder, samtidig med at demokratiet, retsstatsprincippet og miljøet beskyttes.

Vi oplever allerede større opmærksomhed på de juridiske krav i forbindelse med brugen af AI. Derfor har vi bedt vores ekspert og juridiske konsulent, Hugo Lloyd, om at besvare en række spørgsmål om, hvad AI-loven er, og hvad du kan gøre for at være på forkant og opfylde EU's juridiske krav.

Hvad dækker AI-loven over?

At definere hvad der udgør et AI-system har vist sig at være udfordrende, med forskellige forslag fremsat af diverse EU-institutioner. Dog er det seneste forslag i overensstemmelse med, hvordan OECD definerer AI. Forslaget fastslår, at et:

”AI-system' er et maskinbaseret system designet til at fungere med varierende grader af autonomi og som efter implementering kan vise en tilpasningsevne og som, til eksplicitte eller implicitte formål, udleder, fra de input det modtager, hvordan man genererer output såsom forudsigelser, indhold, anbefalinger eller beslutninger, der kan påvirke fysiske eller virtuelle miljøer.”

AI-loven vil gælde både for offentlige og private aktører inden for og uden for EU, så længe AI-systemet er placeret på det europæiske marked, eller dets brug påvirker personer, der befinder sig i EU. Det betyder, at udviklere af AI-systemer og brugere af sådanne systemer kan være forpligtet til at følge forskellige sæt krav.

Hvad er AI-lovens risikoniveauer?

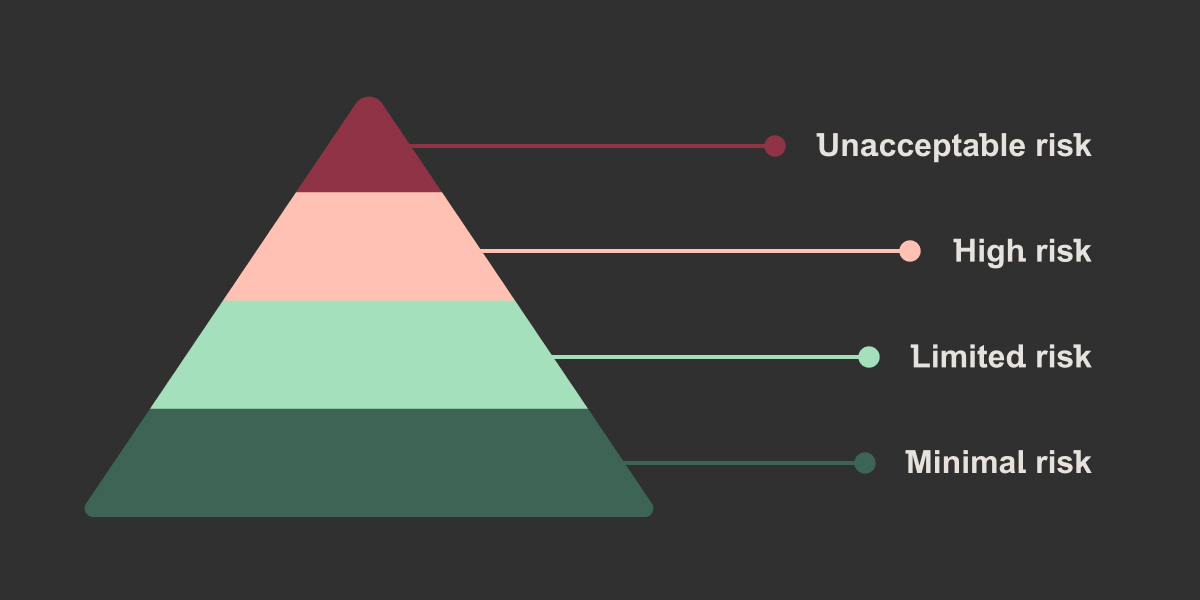

AI-loven kategoriserer AI systemer i fire forskellige niveauer: uacceptabel risiko, høj risiko, begrænset risiko og minimal risiko. Risikoniveauet vil afgøre, om et AI-system er tilladt, og hvilke krav der skal anvendes for at reducere risici.

AI-systemer, der falder ind under kategorien uacceptabel risiko, vil blive forbudt. For eksempel er det forbudt at bruge uretmæssig scraping af internettet eller overvågning for billeder af ansigter til opbygning af- eller udvidelse af databaser være forbudt.

Et AI-system, der betragtes som høj risiko, vil blive underlagt flere krav og skal gennemgå en overensstemmelsesvurdering. For eksempel kan et system, hvor formålet er at bruge det til rekruttering eller udvælgelse af personer, kvalificeres som et AI-system med høj risiko. I sådanne tilfælde kræver en lovlig implementering af et høj risiko AI-system et risikostyringssystem og skal følge kravene til troværdig AI (f.eks. datakvalitet, dokumentation og sporbarhed, gennemsigtighed, menneskelig overvågning, nøjagtighed, cybersikkerhed og robusthed).

Begrænset risiko gælder for AI-systemer med specifikke gennemsigtighedskrav. Når man anvender AI-systemer som chatbots, er det vigtigt for brugerne at de ved, at de interagerer med en maskine, så de har mulighed for at træffe en informeret beslutning om, hvorvidt de vil fortsætte eller afslutte interaktionen.

Hvilke regler gælder for generativ AI?

Udover de førnævnte generelle forpligtelser pålægger det nuværende forslag specifikke forpligtelser ved brugen af visse former for generativ AI eller såkaldte Generel Purpose AI. Generel Purpose AI er alsidig og kan bruges til mange forskellige formål, selv i situationer hvor AI’en ikke blev intentionelt og specifikt designet til det. Sådanne modeller kan udføre flere opgaver på tværs af forskellige domæner og generere indhold som video, tekst, billeder, samtale på tværs af forskellige sprog, beregning eller udvikling af computerkode.

Udbydere af Generel Purpose AI kan blive pålagt at overholde gennemsigtighedskrav, herunder offentliggørelse af oplysninger om den type data, modellen er trænet på. Modeludbydere skal desuden have politikker på plads for at sikre, at de respekterer ophavsretten.

Hvad er konsekvenserne af at overtræde af reglerne?

At undlade at overholde kravene i AI-loven kan resultere i betydelige økonomiske bøder, som vil afhænge af overtrædelsens art med bøder på op til €35 mio. eller 7% af den samlede årlige omsætning.

Hvornår træder AI-loven i kraft?

Forhandlingerne nærmer sig deres afslutning, så nu er spørgsmålet, hvornår AI-loven vil blive håndhævet. Det forventes, at AI-loven vil blive vedtaget og offentliggjort i de kommende måneder. Efter vedtagelse af AI-loven vil reguleringen blive rullet ud i følgende faser:

- 6 måneder: skal EU’s medlemsstater udfase forbudte AI-systemer;

- 12 måneder: forpligtelser for styring af Generel Purpose AI bliver gældende;

- 24 måneder: alle regler i AI-loven bliver gældende, herunder forpligtelser for højrisikosystemer;

- 36 måneder: forpligtelser for højrisikosystemer i overensstemmelse med EU's harmoniseringslovgivning.

Hvad bør du gøre som forberedelse i forhold til AI-loven?

I de kommende år forventes det, at virksomheder og offentlige myndigheder i stigende grad vil anvende AI-systemer. Når brugen af AI-systemer udvides, øges sandsynligheden også for, at virksomheder og offentlige enheder skal overveje AI-reguleringen. Derfor kan det være praktisk allerede nu at tage foretage følgende handlinger:

- Identificer og dokumenter de de AI-systemer I bruger.

- Lav en foreløbig vurdering af, hvilken risikokategori AI-systemet falder ind under. Er det f.eks. et højrisiko-system eller et begrænset risiko AI-system?

- Indarbejd de nye risici forbundet med AI i dine risikostyrings- og udviklingsprocesser.

- Samarbejd i tværfaglige teams, hvor sikkerhedseksperter, advokater og udviklere arbejder sammen.

Det er vores opfattelse, at forskellige typer af AI-systemer vil blive en afgørende faktor for succesfulde organisationer i de kommende år, AI systemer introducerer en række muligheder og risici, og mens vi venter på den formelle vedtagelse af AI-loven, bliver det vigtigt for organisationer ikke kun at forstå, men også at forberede sig på implementering af loven.

Hvis din virksomhed overvejer at implementere AI-systemer, så tøv ikke med at kontakte os hos Knowit. Vi er klar til at sparre med dig om hvordan du skal forberede dig på de kommende reguleringer i din organisation og finde ind til den rigtige AI-løsning for jer.

2 European Commission , Artificial Intelligence – Questions and Answers, 12 dec 2023.

3 European Commission , Artificial Intelligence – Questions and Answers, 12 dec 2023.

4 European Commission , Artificial Intelligence – Questions and Answers, 12 dec 2023.